정확도보단 확률 증대에 집중...편향된 데이터·가중치 등 변수 많아

학계, '설명가능한 AI' 개발 박차...미 방위고등연구계획국 연구 착수

[서울=뉴스핌] 정윤영 기자 = 완벽한 인공지능은 존재할까? 전문가들은 그렇지 않다고 입을 모은다. 앞으로 인공지능이 발전을 거듭한다 해도 '완벽한 인공지능'이 존재하긴 어려울 것으로 전망하고 있다. 그럼에도 학계에선 신뢰할 수 있는 인공지능(XAI, eXplainable AI)에 대한 개발에 속도를 내고 있다. 향후 이 기술이 편향성·신뢰성·차별성 등 기존 인공지능의 단점을 보완할 수 있을지 관심이 모아진다.

최근 학계에선 '신뢰할 수 있는 인공지능'에 대한 관심이 높아지고 있다. 현재로선 인공지능이 결과에 대한 이유를 알 수 없는 '블랙박스'에 가깝다는 판단이다. 사용자에게 결과에 대한 구체적인 이유를 제대로 설명하지 못함에도 사용되는 것은 비교적 실패비용이 적은 이유도 있다.

|

| [서울=뉴스핌] 정윤영 기자 = 최근 세계적으로 '신뢰할 수 있는 인공지능(XAI, eXplainable AI)'에 대한 관심이 높아지고 있다. [사진=픽사베이] 2020.09.22 yoonge93@newspim.com |

◆ 유튜브 알고리즘 추천 오류?..."예측엔 정답이 없다"

유튜브를 시청하다 보면 내 취향과는 동떨어진 영상이 추천영상으로 뜰 때가 있다. 이용자들은 이 경우 "이런 영상을 왜 추천해줘?"라고 의문을 제기한다.

유튜브의 최고 상품 담당자(CPO) 닐 모한이 최근 뉴욕타임스와의 인터뷰에서 밝힌 바에 따르면, 유튜브 이용자들의 시청 시간의 70%가 추천 알고리즘에 의한 결과다. 대다수 이용자들이 인공지능이 골라준 추천 영상을 시청한다는 의미다.

그렇다면 유튜브의 추천영상 알고리즘은 뭐가 잘못된 것일까. 전문가들은 방대한 데이터를 보유하고 있는 유튜브조차도 '예측'에 있어선 정답이 있을 수 없다고 지적한다. 수학과 같이 정답이 있는 문제가 아닌 '예측'에 있어선 확률만 끌어올리면 된다는 것.

이병태 카이스트 교수는 "사람은 하루에도 몇번씩 누구와, 어디에 있느냐에 따라 선호도가 바뀌기 때문에 결국 확률의 문제"라며 심지어 "추천시스템은 100% 정확할 필요도 없다"고 말했다.

최준균 카이스트 교수의 경우 "아직 신뢰성을 얘기할 단계는 아니다"면서 "인공지능 알고리즘이 확률적인 것이기 때문에, 완벽을 기대하는 건 무리"라고 덧붙였다.

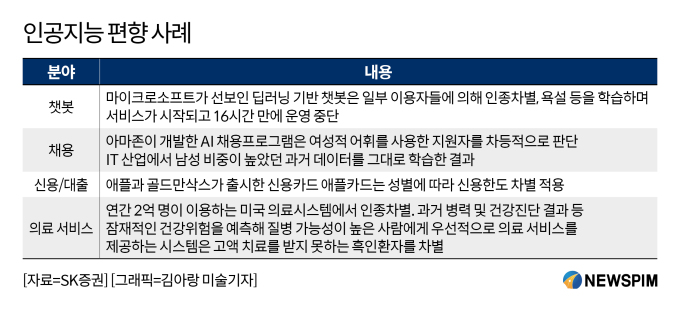

추천 외에도 현(現) 인공지능은 편향성, 차별 등 다양한 문제점을 갖고 있다. 예컨대 성별에 따라 신용 한도를 차별 적용하는 사례가 나오는가 하면, 인공지능이 인종차별을 야기하는 경우도 있다.

인공지능에서 이 같은 문제가 발생하는 이유는 알고리즘 기반이 되는 데이터 때문이다. 인공지능은 데이터를 기계학습시킨 알고리즘으로부터 구현되는데, 일단 수집된 데이터부터 편향적일 수밖에 없다.

또한, 학습하는 단계에서도 데이터의 특징을 어떤 식으로 설정하고 가중치를 부여할지가 인공지능이 '예측'하는데 있어 수 많은 변수가 될 수 있다. 이병태 교수는 "인공지능은 데이터를 통해 기계학습을 한다. 따라서 데이터자체가 편견이나 신뢰성을 결여하고 있으면 결과도 그렇게 나오는것"이라고 설명했다.

|

◆ 학계, 설명가능 인공지능으로 편향성·차별 문제 보완

이에 최근 학계에선 편향된 인공지능을 해결하려는 움직임이 빨라지는 추세다. 여기서 각광받는 기술은 '설명가능한 인공지능'이다.

'설명가능한 인공지능'이란 특정 결과물에 대해 왜 추천했는지, 어떠한 경우에 적용할 수 있는지, 무엇을 수정할 수 있는지 알려주는 기술이다. 인공지능 2.0정도 되는 셈이다.

가장 먼저 설명가능 인공지능을 정의하고 연구를 시작한 기관은 미국의 방위고등연구계획국(DARPA)다.

DARPA 는 '설명능력'을 인공지능이 갖춰야 할 요소로 규정했고, 설명가능 인공지능을 인공지능이 최종 결론에 도달한 이유와 과정을 사람이 이해할 수 있게 설명하는 새로운 소프트웨어로 정의했다.

주요 목표는 인공지능을 이해하고 결과를 신뢰하기 위해 ▲블랙박스 내부를 보여줄 수 있는 '설명모델'과 ▲사용자를 위한 '설명 인터페이스'를 개발하는 것이다.

현재 DARPA 를 중심으로 각 분야의 전문가와 팀을 구성하여 XAI 개발 프로젝트를 진행하고 있으며, 2017년부터 2021년까지 약 800억 원의 예산을 투입할 예정이다.

권순우 SK증권 애널리스트는 "설명가능 인공지능을 통해 판단근거와 신뢰도가 확보되면 이해 관계자들도 편하게 인공지능을 산업과 사회, 법·규제 등에 적용할 수 있다"며 "변화를 체감할 시기가 멀리 있지 않다"고 봤다.

그러면서 "설명가능 인공지능에 필요한 요소로 공정성, 정확도, 인과관계, 신뢰성, 오해 소지가 없는 해석 등이 추가되면서 현실에 적용되는 범위도 확대될 전망"이라고 덧붙였다.

|

yoonge93@newspim.com

영상

영상